1936

Alan Turing, publica «Sobre números computables», introduciendo el concepto de «máquina de Turing«: una representación abstracta de un dispositivo informático que explora el alcance y los límites de lo que se puede calcular.

1943

Los investigadores crearon la primera computadora moderna: una máquina electrónica, digital y programable. De aquí surgieron preguntas fundamentales: ¿pueden pensar las máquinas? ¿Pueden ser inteligentes? ¿Podrán alguna vez ser inteligentes?

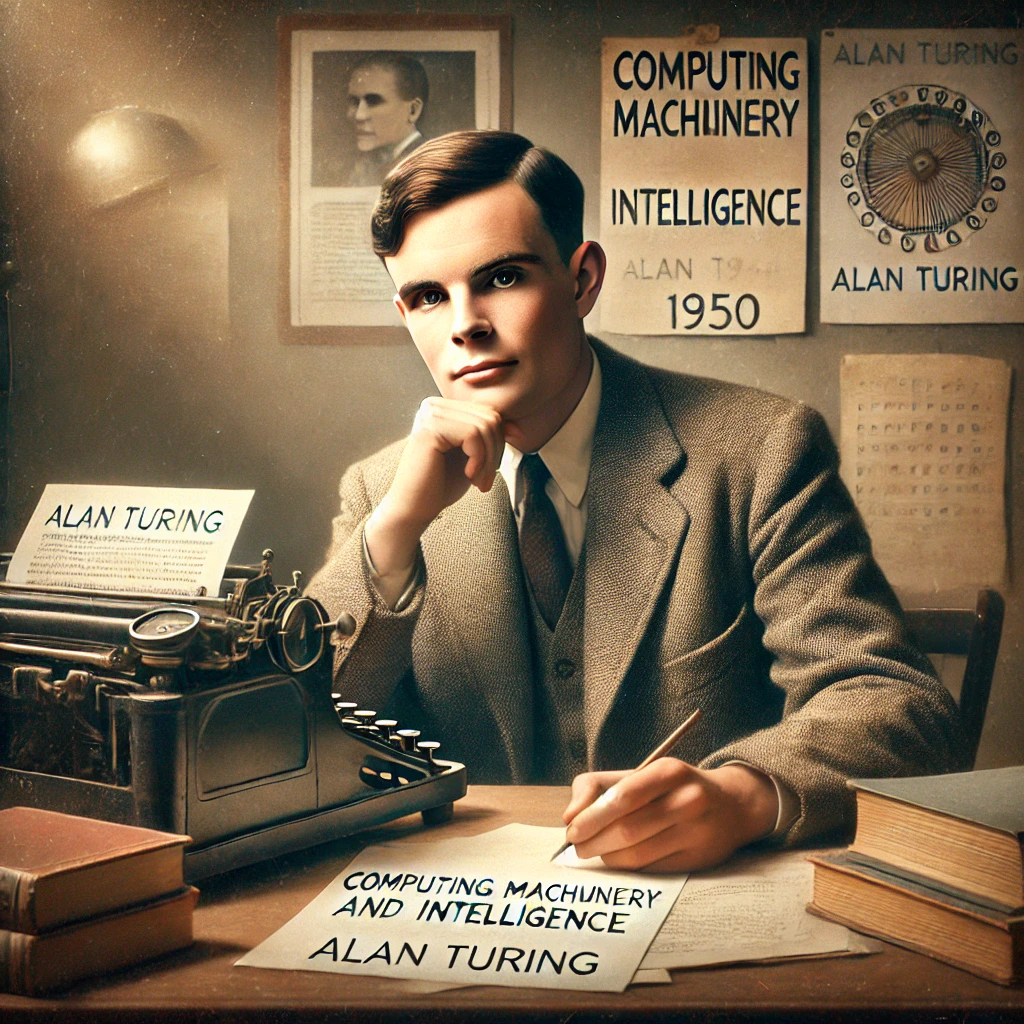

1950

Alan Turing, en el artículo “Computing Machinery and Intelligence” propone dejar de lado el problema de la inteligencia de las máquinas ya que lo que importa no es el mecanismo sino la manifestación de la inteligencia.

Turing sostiene: «si una máquina funciona con tanta eficiencia que los observadores son incapaces de distinguir su comportamiento del de un ser humano, entonces la máquina debe considerarse inteligente».

Turing propone el famoso «Test de Turing» según el cual un ordenador capaz de formular respuestas indistinguibles de las que daría un ser humano debería considerarse una máquina inteligente.

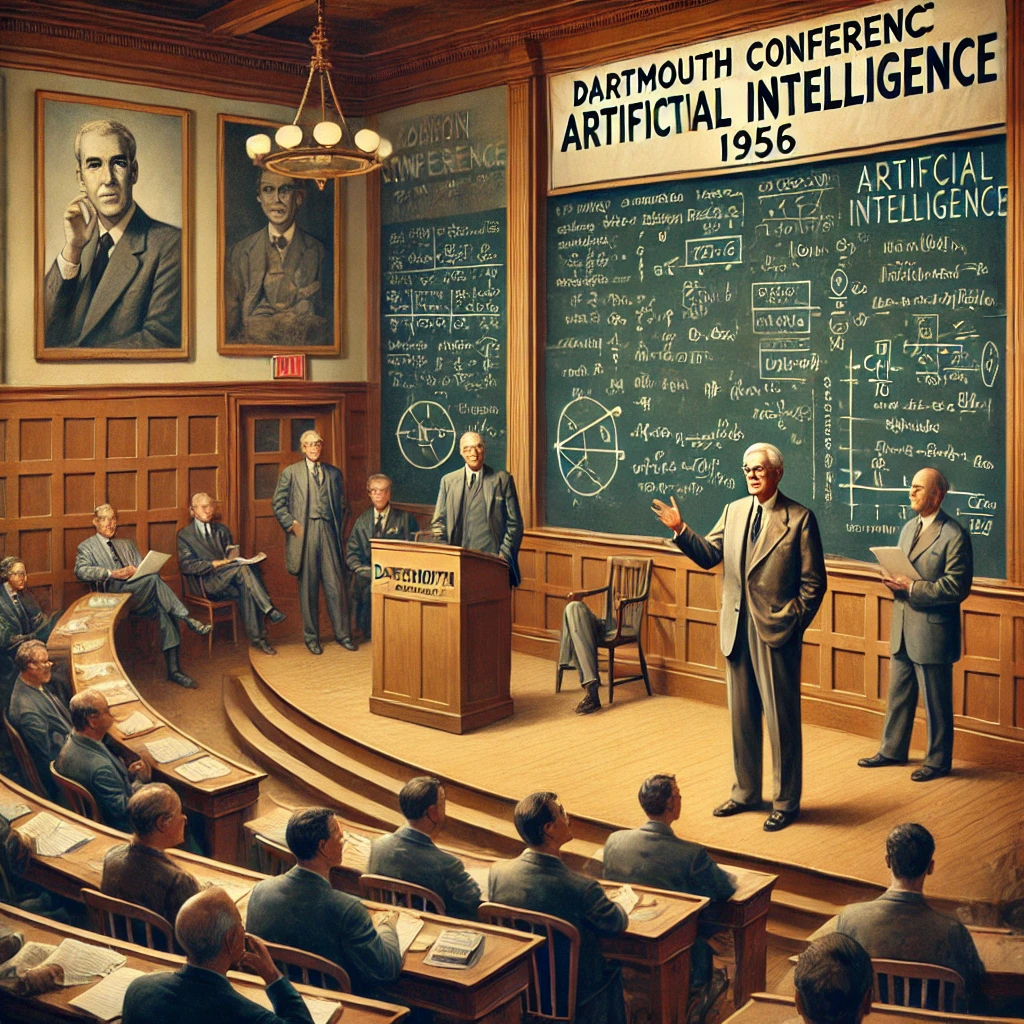

1956

El informático y matemático John McCarthy organiza una conferencia en el Dartmouth College para explorar la posibilidad de crear máquinas pensantes. Durante el evento acuñó la expresión «inteligencia artificial», definiéndola como la capacidad de las máquinas para realizar tareas propias de la inteligencia humana».

1966

Joseph Weizenbaum crea ELIZA, un chatbot (asistente virtual) líder. El programa imita la actitud comprensiva y atenta de un terapeuta y resulta especialmente convincente.

1968

El ordenador HAL 9000, protagonista de la película «2001: Odisea en el espacio» de Stanley Kubrick, escrita en colaboración con Arthur C. Clarke, influirá profundamente en el imaginario colectivo de la inteligencia artificial.

1969

Marvin Minsky y Seymour Papert publican «Perceptrones», un análisis de los límites y el potencial de las redes neuronales, modelos inspirados en el cerebro humano que procesan información a través de ‘neuronas’ artificiales. El libro destaca limitaciones importantes, como la incapacidad de resolver problemas no lineales, y contribuye al primer «invierno de la IA», pero también sienta las bases para futuras investigaciones sobre redes neuronales más avanzadas.

Setenta

La década del llamado ‘invierno de la IA’. Tras la publicación de dos informes muy pesimistas, encargados por los gobiernos estadounidense y británico, la financiación pública para la investigación en el campo de la inteligencia artificial se redujo drásticamente.

Los dos documentos clave fueron:

- 1966, «Discusión preliminar sobre el problema de la inteligencia artificial», escrito por ARPA (Agencia de Proyectos de Investigación Avanzada, más tarde conocida como DARPA).

- 1973, «El Informe Lighthill», encargado por el gobierno británico

1980

Se celebra en la Universidad de Stanford, en Estados Unidos, la primera conferencia nacional de la Asociación Americana para la Inteligencia Artificial (AAAI), evento que marca un paso importante en la difusión y reconocimiento de la IA como disciplina científica

1997

La supercomputadora Deep Blue de IBM derrota al campeón mundial de ajedrez Garry Kasparov, marcando un hito importante en la inteligencia artificial.

En una de las partidas, Deep Blue hace un movimiento inesperado que deja a Kasparov profundamente desorientado. Esta medida, inicialmente interpretada como una estrategia avanzada, puede haber sido el resultado de un error de cálculo. Sin embargo, el gesto demostró cómo una lógica carente de emociones y prejuicios puede sorprender incluso a los jugadores más expertos, abriendo el debate sobre una posible «lógica superior» que supera la humana.

2011

IBM Watson gana el concurso televisivo de conocimientos generales Jeopardy! contra los dos mejores campeones de la retransmisión.

El juego consiste en formular la pregunta correcta a partir de una respuesta dada. La inteligencia artificial demostró cómo una máquina podría interpretar y responder a un juego basándose en conocimientos generales y comprensión del lenguaje, una habilidad que requiere habilidades complejas.

2014

El chatbot Eugene Goostman desarrollado por el ruso Vladimir Veselov (residente de Estados Unidos) y el ucraniano Eugene Demchenko (residente de Rusia), pasa una versión del Test de Turing.

Eugene Goostman está diseñado para simular a un niño ucraniano de trece años. Aunque fue recibido con escepticismo por la comunidad científica, este resultado ha llamado la atención de los medios sobre el potencial de los chatbots y la inteligencia artificial conversacional.

2016

AlphaGo desarrollado por DeepMind, derrota al campeón mundial de Go, Lee Sedol, en una serie de partidos históricos.

El Go es un antiguo juego estratégico, originario del Lejano Oriente, conocido por su complejidad e imprevisibilidad, considerado muy superior al del ajedrez. La victoria de AlphaGo representa un logro extraordinario para la inteligencia artificial, logrado gracias al uso de redes neuronales profundas y aprendizaje por refuerzo, que permiten a la IA abordar problemas complejos e impredecibles.

Un momento icónico del desafío fue el ‘Move 37’ en el segundo juego: un movimiento aparentemente ilógico para jugadores humanos, pero extraordinariamente efectivo, que dejó profundamente sorprendidos a Lee Sedol y a los expertos en Go. Esto demostró cómo la IA puede encontrar soluciones innovadoras que eluden incluso a los mejores jugadores humanos. Sin embargo, Lee Sedol tuvo su momento de gloria en la cuarta partida, cuando sorprendió a AlphaGo con el ‘Move 78’, forzando al sistema a cometer un error y ganando la partida. Esta victoria demostró que, a pesar del progreso de la IA, la creatividad y la intuición humanas aún conservan un valor único.

La derrota contra AlphaGo fue una experiencia emocionalmente intensa para Lee Sedol, quien reflexionó sobre la naturaleza del juego y el futuro de las competiciones entre hombre y máquina. El desafío entre AlphaGo y Lee Sedol se ha vuelto simbólico, destacando las fortalezas y los límites de la inteligencia humana y artificial.

2018

La IA de Google, Duplex, puede reservar una cita en la peluquería y pedir información en un restaurante hablando por teléfono como cualquier otro cliente.

Duplex utiliza tecnología avanzada de generación y comprensión del lenguaje natural, incluidos elementos como pausas e inflexiones vocales, para hacer que la conversación sea extremadamente realista.

Esta demostración demostró las capacidades de la IA para interactuar en contextos cotidianos, al tiempo que planteó cuestiones éticas sobre la transparencia en el uso de máquinas en las interacciones humanas.

2020

OpeAI lanza GPT-3, una inteligencia artificial basada en un modelo de lenguaje grande (LLM), que, en el momento de su lanzamiento, representaba el modelo de lenguaje más potente jamás creado, con 175 mil millones de parámetros.

GPT-3 ha demostrado capacidades asombrosas para generar texto, responder preguntas y producir contenido creativo, abriendo nuevas perspectivas para la IA.

2022

OpenAI lanza DALL-E 2, un modelo de inteligencia artificial capaz de generar imágenes a partir de descripciones textuales, mostrando una nueva frontera de la creatividad asistida por IA.

Ese mismo año se lanzó ChatGPT, una variante de GPT-3 optimizada para interacciones conversacionales, capaz de entablar un diálogo natural y proporcionar respuestas detalladas sobre una amplia gama de temas.

2023

OpenAI lanza GPT-4, una versión aún más avanzada y sofisticada de su modelo de lenguaje, capaz de comprender y generar textos con mayor precisión, contextualidad y coherencia.

GPT-4 destaca por su capacidad para manejar conversaciones más complejas, responder preguntas técnicas con una precisión superior e interpretar matices lingüísticos que mejoran la interacción con los usuarios.